Mi intención con este artículo es dejar clara cualquier duda acerca de los programas de scrapeo, qué son los proxys o footprints y para qué se usa la combinación de los tres juntos, viendo un ejemplo práctico con GScraper.

Puede que para algunos sea un artículo básico, pero a mí me costó mucho entender la mecánica sobre la que iba todo este tema, así que espero poder ayudar a todas esas personas que se encuentran como yo hace un tiempo.

¿Qué es scrapear?

En primer lugar, una palabra fea.

Scrapear significa obtener una lista de un montón de páginas web para conseguir información sobre ellas.

Por ello, muchas veces se realizan búsquedas personalizadas en las que el administrador dice: «bueno, yo quiero que solo me aparezcan webs que incluyan la keyword SEO», y gracias a un programa consigue una lista de muchas páginas web con esa keyword y, además, con información sobre cada sitio. Interesante, ¿verdad?

Por ejemplo, nos pueden informar sobre el enlace en el que se encuentra la keyword en esa web, el PR, el DA y PA, los backlinks… Todo depende del programa que usemos, que nos dará una información u otra.

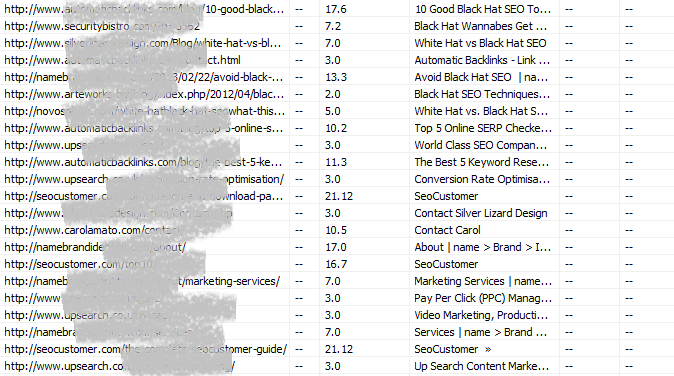

Por ejemplo, esto es un scrapeo mediante un programa llamado GScrapper, que lo veremos a continuación:

¿Qué son los proxys?

Se trata de un punto intermedio entre el servidor y el cliente. Si no tienes conocimientos sobre estos temas (como yo) te lo explicaré en palabras vulgares: nos permiten hacen scrapeos sin que Google nos pille. Si no usamos proxys durante el proceso de scrapeo, corremos el riesgo de que Google vea que estamos haciendo una técnica «ilegal» y nos puede penalizar, como ponernos un captcha cada vez que vayamos a realizar una búsqueda en Google (yo lo he sufrido. Luego, si dejas un tiempo de hacer eso, el catpcha se va solo y vuelves a estar como antes).

Por lo tanto, siempre hay que usar proxys mientras scrapeamos.

Hay dos tipos: los públicos y los privados.

Los públicos los encuentras en Internet fácilmente con buscar «public proxys updated» (lista de proxys actualizados) y puedes usar unos cuantos para realizar el scrapeo (mientras más mejor). Eso sí, van a ir regular porque los van a usar todo el mundo. Además, con el paso del tiempo (cuestión de minutos incluso) su rendimiento va empeorando por eso mismo, porque la gente los usa mucho, entonces mientras más nuevos sean, mejor.

Podéis sacarlos de webs como esta o esta, que están constantemente actualizándolos.

Si quieres más profesionalidad y que todo funcione mejor puedes contratar a personas que te den proxys privados, es decir, que solo tú usarás y, por tanto, irán más rápidos y funcionarán mejor. Puedes encontrar a gente que los venda en foros de SEO o en Fiverr.

¿Qué son los footprints?

Y aquí saltamos a algo más normal, sin tanta complicación.

Un footprint es un comando que activa solo páginas web que incluyan las variables que posee. A ver, ya estoy con palabras raras de nuevo (es inevitable, lo siento, alguien lo entenderá a la primera 😀 ). Os pongo un ejemplo. Un footprint puede ser:

inurl:tumblr.com «liked»

Lo que estamos diciéndole a Google es que muestre solo blogs de Tumblr.com (inurl:tumblr.com) y que incluyan la palabra «liked». Si ponemos «marketing» pues solo nos mostrará blogs de Tumblr que incluyan la palabra marketing. Fácil, ¿verdad?

Para un scrapeo necesitamos especificar qué footprints queremos. Normalmente las páginas web siempre incluyen el típico «Deja tu comentario», «Dejar comentario», o en inglés «Leave a comment», así que si queremos encontrar gran variedad de blogs podemos usar ese footprint.

Hay muchísimos footprints. Puedes ver algunos aquí. De todas formas, cuando veamos GScraper lo veréis más claramente.

¿Para qué se usa el scrapeo?

Normalmente para realizar backlinks masivos hacia las páginas que nos han salido en la lista. El programa hace el envío masivo de enlaces automáticamente, así que solo tienes que sentarte y esperar.

Otros prefieren sacar los mejores sitios manualmente para contactar con el administrador y llegar a acuerdos con intercambios de enlaces o compra de reseñas, realizar comentarios de calidad en noticias dejando un enlace…

En definitiva, todo lo que se te ocurra con una lista gigante de páginas web relacionadas a la tuya.

1. Tutorial GScraper: pestañas básicas

Ya hemos llegado a la parte práctica. Vamos a ver cómo conseguir esa lista de webs que a nosotros nos interesan para dejar backlinks.

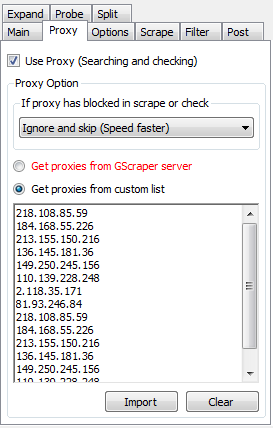

1. Ir a la pestaña «Proxys»

Si marcamos «Use proxy» podemos usar proxys que hayamos cogido (públicos o privados). Como ya os dije, tened siempre marcada esa opción y no hagáis el scrapeo con vuestra propia IP.

En el cuadro de abajo debemos poner todos los proxys que podamos. Mientras más, mejor. Podemos importar una lista de proxys de un archivo .txt, es decir, colocas en un bloc de notas todos los proxys que hayas encontrado o comprado y mediante la opción de importar subes todos de una vez.

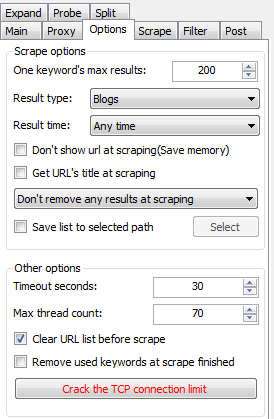

2. Pestaña de «Options»

En esta pestaña vamos a ver opciones sobre cómo queremos el scrapeo. En la primera pestaña diremos cuántos resultados máximos queremos. Por defecto vienen 500, pero yo lo tengo en 200 porque a veces el programa se cierra por sobrecarga. Si os ocurre solo tenéis que bajar ese número o mejorar los proxys que tenéis.

También podéis decir si queréis encontrar blogs, vídeos, imágenes… Y la antigüedad de los sitios, que por defecto viene «Any time», es decir, en cualquiera.

El resto lo dejamos igual.

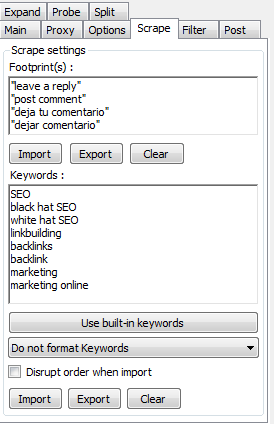

3. Pestaña «Scrape»

Aquí tenemos que incluir datos sobre el scrapeo. En primer lugar los footprints. Como dije lo de los comentarios está en casi todos los sitios, así que conseguirás un número más amplio de sitios. Yo los he incluido con textos tanto en español como en inglés, para así obtener blogs de ambos idiomas. Por ejemplo, un footprint «Leave a reply» y otro «Deja tu comentario».

Las keywords son las palabras clave que queremos que incluyan los blogs que nos muestren. Si yo quiero noticias para Campamento Web, puedo poner las keywords de SEO, marketing online, marketing, backlinks… Hay gente que incluye hasta 500 keywords, así que no te cortes y usa todas las que puedas, ya que así tendrás más resultados.

En el botón que hay abajo le damos a «Start scrape» y empezará con su trabajo.

2. Consiguiendo páginas similares de autoridad

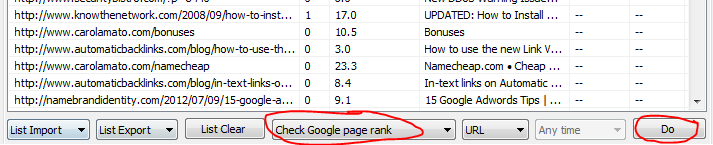

Veremos que los blogs mostrados no muestran apenas información. Para que nos muestren el PR (Page Rank) tenemos que ir a un menú que hay abajo de las URLs mostradas, y seleccionamos en la cuarta pestaña «Check Google page rank» y, finalmente, hacemos clic en «Do».

Podemos ver más información, pero por el momento el PR nos será suficiente para encontrar blogs de autoridad.

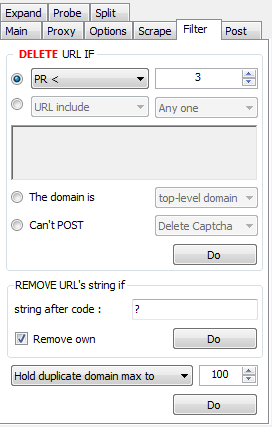

A continuación, cuando se haya mostrado el PR de las URLs tienes que ir a la pestaña de «Filter«. Allí puedes filtrar los resultados. Por ejemplo, como en la imagen, que se eliminen todos los sitios que tengan un PR menor que 3, para quedarnos solo con aquellos sitios que tienen mediana y alta autoridad.

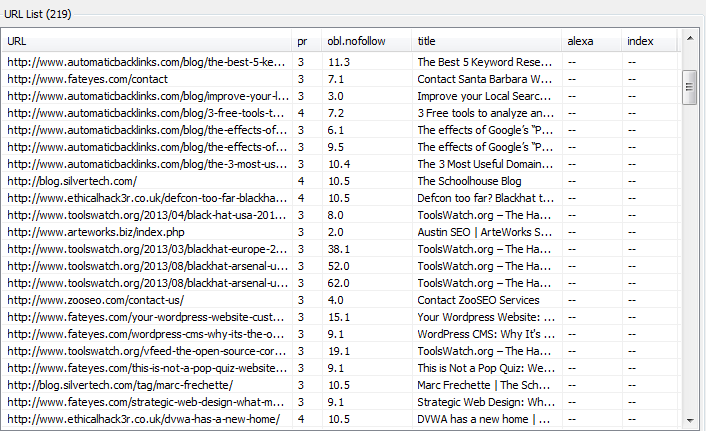

Como podemos ver, ahora la lista está limpia con sitios que tienen 3 o más PR. Si quieres ir más allá, puedes ver ahora las webs con más backlinks, con mejor posición en Alexa, o cualquier otro dato que te parezca interesante. Incluso podemos eliminar aquellos enlaces que provengan del mismo sitio web (con la opción «Remove duplicate domain», para dominios duplicados, o «Remove duplicate URL», para enlaces duplicados completamente).

Con esta lista de blogs relacionados al nuestro podemos hacer muchas cosas: ir uno por uno colocando un comentario con publicidad, contactar con administradores para comprar reseñas en los sitios que más te gusten, llegar a un acuerdo para un intercambio de enlaces…

O si no, también puedes hacer miles de backlinks automáticos, que te pueden servir para los Tiers. No hagas nunca backlinks masivos hacia el sitio principal, porque serás penalizado por Google.

3. Realizar backlinks masivos

Ahora vamos a aprender una técnica muy usada en el Black Hat: enviar miles de backlinks a un sitio web. Se harán mediante comentarios que incluirán un enlace a nuestro sitio (hacia un Tier, no a la página web principal) y se publicarán automáticamente en todos los sitios que hemos conseguido en nuestra lista.

Ojo, si eres nuevo, recuerda que enviar backlinks masivos hará que tu web sea penalizada al cabo de poco tiempo por Google. Esto se usa para Tiers, no para el sitio principal.

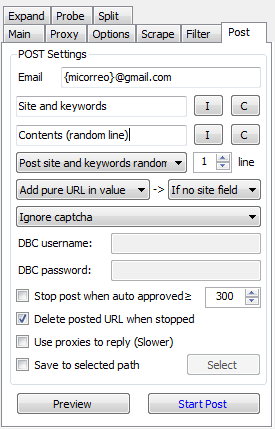

Para llevarlo a cabo vamos a la pestaña «Post«.

En «Email» tenemos que poner el correo mediante el cual se realizarán los comentarios en todos los sitios web que incluirán un enlace. Podemos poner varios para que se vayan alternando de la siguiente forma {micorreo|otrocorreo|tercercorreo}@gmail.com, y se irán intercambiando aleatoriamente entre «micorreo@gmail.com», «otrocorreo@gmail.com» y «tercercorreo@gmail.com». Es decir, lo que está en los corchetes se va alternando al azar.

En «Site and keywords» debemos darle a «I» y añadir un bloc de notas (.txt) que incluya, en primer lugar, el enlace de la web a la que vamos a enviarle los backlinks, y en corchetes nuestro nombre, que será el nombre de usuario que se mostrará en los comentarios. Por ejemplo, yo podría hacer un .txt con este contenido:

https://campamentoweb.com{Emilio}

En «Contents» tenemos que hacer lo mismo, le damos a «I» e importamos el contenido del comentario en un bloc de notas (.txt). Como este comentario se va a publicar en cualquier sitio de nuestra lista, tenemos que intentar que parezca natural y se acomode a cualquier tipo de artículo. Si una persona habla sobre patos y comentas: «Gracias por publicar sobre esta colonia», el administrador no aceptará tu comentario. Si hablas de forma más genérica, por ejemplo: «Muy interesante lo que comentas en el artículo, he descubierto el blog y estoy encontrando muchísimo contenido de calidad. ¡Saludos y gracias!», conseguirás que te aprueben más veces los comentarios.

«Stop posts when auto approved» nos permite establecer un límite. Por ejemplo, cuando nos hayan publicado mil comentarios (por lo tanto, mil backlinks). Para eso solo tenemos que cambiar la cifra por «1.000», y dejarán de enviarse comentarios cuando se supere dicho valor.

Finalmente, le damos al botón de «Start Post» y el programa comenzará a trabajar.

Descargar GScraper gratis

El programa cuesta 68$ (49€) pero en Campamento Web te lo damos completamente gratis. Eso sí, para seguir guardando cierta exclusividad (y recompensar el esfuerzo de este artículo) tan solo pido una acción social en cualquiera de las tres redes sociales más conocidas.

Un clic a cambio de un programa valorado en 68$. Un buen trato, ¿verdad?

[sociallocker]

¡Descargar GScraper ahora!

[/sociallocker]

Bueno, no es un tema que personalmente me interese mucho, pero vale la explicación, como siempre bien detallado y fácil de entender. No utilizaría estos programas, mas bien me gusta lo natural, como dices lo podría utilizar para encontrar blogs con autoridad relacionados al mio, pero contactar al dueño o comprar una reseña. Mas allá de eso se que le será de mucha utilidad a quienes les interesa este método para conseguir backlinks, lo que les recomendaría que esos backlinks no los envíen al home de su blog, sino crear blogs satélites que apunten a tu blog y enviar enlaces masivos a ellos.

Exacto Ángel, esto es perfecto para Tiers, pero para el blog principal solo te va a traer problemas, a no ser que estemos hablando de nichos temporales. Por ejemplo, un partidazo de fútbol, que da igual si nos banean unos días más tarde, porque ya ha pasado. Solo nos interesa posicionarnos rápido para ese día, el resto da igual.

Gracias por tu comentario, como siempre, ¡fiel lector! 😀

He aprendido estos procesos muy detallados, no solo en este post si no en los anteriores, gracias a tu disposición y tiempo, solo quise escribir este comentario para agradecértelo.

Hola Herbert, muchas gracias a ti por pasarte a comentar, estos mensajes animan mucho a seguir adelante 🙂

Estaba leyendo el post poco a poco, y me aclaraste más de una duda, sin embargo decía entre mi, el detalle es que tengo que comprar el software, o donde conseguirlo, pero ahora veo que lo publicas gratis y eso es de gran valor, volveré a leerme el post completo.

Saludos Emilio, gran trabajo. (y)

Me alegro de que te haya servido, para cualquier duda aquí estoy 🙂

Tremendo tutorial que te has currado, te está quedando muy bien el blog y le estás metiendo muy buen contenido

Saludos Emilio

Wow, hola Alejandro!

Me alegro mucho de recibir un comentario positivo tuyo, eso indica que voy por buen camino sin ninguna duda, jajaja

Espero verte más por aquí 😉

Un abrazo!

Hola Emilio,

nunca habia entendido bien que es eso de los proxys y ahora tengo más claro el concepto, sin embargo me surgen todavia dudas sobre los proxys privados. Si quiero scrapear ¿cuantos proxys como minimo se necesitan comprar para que funcione bien la cosa? ¿esos proxys privados tambien se «gastan», es decir, qué vida útil tienen? ¿cómo se nota que los proxys ya no son buenos o no funcionan? ¿y más o menos cuanto dinero cuestan?

Felicidades por el post.

¡Un saludo!

Hola Edu,

Me alegro de que el post te haya aclarado un poco más las cosas.

– La duración y la cantidad de proxys es muy subjetivo, depende mucho de la calidad de éstos y los backlinks que quieras hacer. No obstante, al final te voy a dejar una web donde venden proxys privados por meses, y si alguno se cae, te lo renuevan.

Para que te hagas una idea, con 10 proxys puedes hacer blasteos masivos buenos, y con 100 bastante eficaces.

– Simplemente no son buenos cuando notes que el scrapeo tarda más que antes y se hace lento.

– Pues varía de done los compres. Por ejemplo, puedes comprar en Black Hat World o en http://cheapprivateproxies.org/

Saludos!

Pedazo de post, enhorabuena, sin duda a probarlo y a seguir tus consejos, muchísimas gracias

Gracias a ti por el comentario Álvaro 🙂

una pregunta si yo tengo los links que me baje de algunas paginas web en vez de buscar esas web en el programa, quisiera importarlas donde lo haria?

Hola Edson,

Tendrías que ir a la pestaña de «Proxy» y seleccionar allí el botón de «Import» para adjuntar el .txt que incluya una lista de todos los proxis que vayas a usar.

o que genial y una duda los comentarios que postea automaticamente donde lo veo…hay alguna forma d ever las paginas donde se han posteado con exito y si tengo por decor 100 url de paginas web que he encontrado sin scrapear…donde lo pongo??? a y excelente información…

Como te dije en un comentario anterior, mediante herramientas que detecten los backlinks de sitios web.

Si han fallado es porque no han pasado la moderación de comentarios porque el administrador ha visto que son spam, así que tendrías que probar a hacer comentarios manualmente intentando dar más naturalidad.

a genial una pregunta mas y como hago para ver que comentarios lograron postearse…ah muy buen blog

Para eso necesitas algún programa o herramienta que revise los backlinks. Por ejemplo, Ahrefs.

Hola Emilio.

Enhorabuena por el post, un buen tutorial para los que comenzamos con GScraper.

Sólo un detalle, yo llegué aquí buscando alguna lista de footprints en español para GScraper pero donde pones «Puedes ver algunos aquí» no hay enlace.

¿Tienes algo de información al respecto?

Gracias.

Hola Galidor,

Disculpa, no sé por qué no se muestra el enlace porque lo tengo puesto :S Te lo paso por aquí:

http://www.blackhatworld.com/blackhat-seo/black-hat-seo/491042-get-huge-search-engine-optimization-footprints-collections.html

Saludos!

Gracias Emilio explicaste perfectamente como utilizar esta herramienta, Saludos!

Muchas gracias Miguel! 🙂

Hola Emilio,

Muy bien explicado el post. Hay algo que no consigo entender del black hat. Dices que los backlinks masivos no pueden ir al sitio principal ya que penalizan, entonces, si los mandamos a un tier, ¿no lo van a penalizar igual?

¿No es mejor conseguir enlaces de calidad con reseñas directamente a la web principal y no perder tiempo en tiers y spam?

Muchas gracias.

Hola David,

Lo bueno de hacer tiers es que consiguen muchísima autoridad con los backlinks masivos, aunque en un futuro sean penalizados, y al enlazar a tu web principal va a tener un buen subidón.

Eso sí, hacer los tiers requiere de bastante dedicación y yo soy de los que prefieren reseñas de calidad para posicionar.

Saludos!

Buenas, he intentando hacerlo paso a paso como dices, cambiando y añadiendo proxy de muchas webs que he visto, y con muchas keywords… todo lo que dices vaya, y no me funciona no me vuelca ninguna URL, así que no puedo seguir operando… ¿Se te ocurre algún motivo?

Hace falta estar logueado?..

Espero poder arreglarlo que tengo muchas ganas de ver qué resultados me da.

Saludos

Hola Álvaro,

Yo también tenía al principio ese mismo error. A veces me daba resultados y otros no. La solución estuvo en buscar aún más proxys y disminuir la cantidad de resultados que obtenía en la lista.

Saludos!

Me has gustado nadie explica que scrapear y para que sirve mucgos tutoriales del programa scrapebox pero nadie explica para que sirve por cierto no esta nada claro como descargar el programa de todos m mi click ha sido en los tres redes sociales que tienes ene el blog

Me alegro de que te haya servido 🙂

Qué raro que no te funcione, pásame tu correo y te mando el link.

Saludos!

Buen post para comprender el mundo del scrapeo y los footprints.

Emilio, he probado a bajarme el programa y me dan trojanos por todos lados?

alguna otra manera-?

gracias

Hola Jimbo!

Es normal que detecte troyanos, pero no porque haya, sino porque es como un programa mal visto por los antivirus ya que sirve para realizar cosas «indebidas». Mi recomendación es que desactives el antivirus mientras lo descargas, porque virus no hay, te lo aseguro.

Saludos!

Hola, Primero enhorabuena, hace unos días que conocí tu blog y estoy a piñón fijo viendo tus post desde entonces.

Hace poco cree un blog en WP, al poco de publicar algo de contenido hice ping en varios servicios para que indexara más rápido. Como el blog es de reciente creación todavía no tiene ningún backlink, pero según ahrefs tiene 769 backlinks con un dofollow entre ellos (aunque utilizando otras herramientas no me da ningún backlink, ni siquiera el dofollow).

¿Estos backlinks son debidos al ping que realice?

¿Son de la misma naturaleza o valor que los que se generarían de forma masiva para un Tier2 o Tier3?

Al ser nofollow me imagino que no tienen repercusión negativa, ¿no?.

Saludos

Hola Jota, pueden ser dos cosas:

1. Si el dominio es expirado, que sean de la «etapa anterior» del blog

2. Si el dominio es nuevo, será cosa del Ping

Al ser nofollow no va a pasar nada y no tienen valor, ni siquiera como un tier 2 o 3, pero no te recomiendo hacer muchos pings. Espera a que Google los indexe de forma natural. Si quieres backlinks entonces cómpralos o haz intercambios, que seguro que te irá mucho mejor.

Saludos!

Ok gracias, tomo nota de no hacer mucho ping.

Otra cosa,instale GScraper y al hacer una prueba utilizando una buena lista de proxys en la barra inferior aparece este mensaje: «received proxies from the server:0» y no aparece ningún elemento en la lista. No es que haya utilizado muchas keywords (unas 10) pero me parece extraño. ¿hago algo mal?

saludos y gracias

Puessss… La verdad es que nunca he tenido ese error y en Google no hay información sobre él. Prueba poniendo proxys de otros sitios, porque el problema está en que no se han enviado bien.

Buenas, me ocurre el mismo error, e probado muchas proxys pero sigue poniendo abajo 0 y no escanea nada 🙁

Hola Emilio. Yo llegue aqui por que quiero hacer una investigación en un sitio web sobre información que han publicado a lo largo de un año. La idea es bajar la información para ordenarla en mi computadora. Según he leido se usa la técnica de scrapers. Te agrdeceré si me orientas al respecto. Gracias.

Hola Ricardo,

Para scrapear la información de una página usa el siguiente footprint:

inurl:ejemplo.com

De esta forma te saldrán todas las URLs que tiene la página y con un Excel puedes ordenarlas.

Saludos!

Hola Emilio!

Una duda, qué diferencia hay entre gscraper y scrapebox? Cual es mejor?

Gracias!

Hola Rober,

La diferencia está en la eficacia para detectar enlaces. El mejor sin duda es Scrapebox, pero Gscraper para comenzar no está mal.

Saludos!

Muy bueno, pero tengo una preguntita, que hay si No tenemos red de blogs ?

Crees que mandar backlinks (digamos unos 200 mas o menos, no miles) directamente a mi web, pero tratando de hacerlo con un numero bajo de backlinks resultaria igualmente en una penalizacion de google? Entiendo que es algo arriesgado…

Hola Manoleto,

Así es, lo más seguro es que te penalicen. No hace falta gastar dinero en crear una red de blogs. Puedes crear tus propios blogs 2.0 como tier. Por ejemplo, blogs en Blogger.

Saludos!

Te has currado una guía perfecta (al menos para mi).

No te has saltado ningún detalle y por fin he podido sacarle partido a esta herramienta, que por cierto, descargué de Chuiso hace bastante tiempo (otro colega tuyo creo), jejeje.

Ya he realizado mis primeros backlinks a un micronicho que he montado hace poco, la verdad es que hubiera preferido tener un Tier 2 más extenso pero al crear los blogs a mano la verdad es que da un palo tremendo.

Haber si en unos días puedo comprar el Senuke XCR y así crear más cuentas/perfiles/blogs en mucho menos tiempo… si no es mucha molestia, tu lo recomiendas o prefieres otra herramienta?

En fin, gracias por este gran artículo.

Saludos!

Hola David!

Gracias por tu comentario, me alegro mucho de que te haya servido el post 🙂

Senuke XCR te puede servir, pero no lo he probado. El que sí he probado y funciona muy bien es FCS Networker aunque tutoriales en español vas a encontrar pocos. De todas formas Senuke XCR tiene una versión de prueba de 14 días y puedes cancelar la suscripción en Paypal antes de que se termine, así que puedes ver qué tal te va con ella.

Saludos!

Hola Emilio que hermoso tu articulo, te quedo estupendo justo buscaba información. Te felicito y quería preguntarte algo:

Que software para enviar enlaces masivos me recomiendas:

1. Pensé que el GSA era gscraper?

2. No Hands SEO?

3. Scrapebox?

Al principio me estaba inclinando por el No Hands SEO, por lo fácil que es crear enlaces, pero de ahí me entere que se necesita muchas capchas y proxis para que funcione, ademas no quiero que de ahí google me este poniendo capchas.

Luego me entere del Scrapebox, al parecer viene incluido una sección de proxys que es suficiente para cierta cantidad de envió y no se necesita capchas. En este caso no se si es necesario utilizar un VPS y hacerlo tranquilamente desde mi pc.?

Hola Juan,

GSA es otro programa, no es GScraper. No estoy muy familiarizado con estos programas, pero según las experiencias de algunos conocidos GSA es el mejor de todos. Los proxies y captchas los vas a necesitar en todos siempre que vayas a scrapear, no es algo único de No Hands SEO. Ahora bien, si te refieres a que requiere de más proxies que el resto, eso ya no lo sé. De todas formas los captchas no son necesarios, aunque sí mejorarán la efectividad del envío masivo por si aparece alguno antes de enviar un comentario, por ejemplo. Y sí, se puede usar un VPS.

Saludos!

buenas noches, el programa parece funcionar bien, 115000 paginas encontradas y subiendo, velocidad 3141, pero al 5% de completado sigo sin ver en pantalla las paginas escrapeadas, y los proxys from server siguen en 0 (le puse 1000 de ghater proxy).

deseo saber, por favor, si el funcionamiento es correcto o no

gracias

Hola Miguel, ¿si pausas el scrapeo sigue sin actualizarse la lista de páginas scrapeadas?

No está mal el artículo, pero el archivo de descarga TIENE 23 VIRUS.

———————————————————————————————–

ALYac Gen:Variant.Kazy.392187

AVware Trojan.Win32.Generic!BT

Agnitum Riskware.Agent!

Arcabit Trojan.Kazy.D5FBFB

Avast Win32:Tcpz-B [PUP]

Avira TR/Agent.820736.26

Baidu-International Hacktool.Win32.TCPZ.F

BitDefender Gen:Variant.Kazy.392187

Cyren W32/Trojan.AKJL-3947

ESET-NOD32 a variant of Win32/TCPZ.F potentially unsafe

Emsisoft Gen:Variant.Kazy.392187 (B)

F-Secure Gen:Variant.Kazy.392187

GData Gen:Variant.Kazy.392187

Ikarus Trojan-Dropper.Agent

K7AntiVirus Trojan ( 0048cc631 )

K7GW Trojan ( 0048cc631 )

MicroWorld-eScan Gen:Variant.Kazy.392187

Sophos Generic PUA BL (PUA)

Symantec Trojan.Gen.2

Tencent Win32.Trojan.Agent.Ahoi

TrendMicro HKTL_SCRAPER

TrendMicro-HouseCall HKTL_SCRAPER

VIPRE Trojan.Win32.Generic!BT

—————————————————————————————————–

POR FAVOR: SI VAS A COMPARTIR UN PROGRAMA PIRATA, AVISA ANTES DE LA POSIBILIDAD DE INFECCIÓN. No todos los usuarios conocen los riesgos.

Gracias

Hola Jorge, es muy probable que sean avisos falsos. Este tipo de programas suelen ser detectados como amenazas por antivirus.

Saludos!

Buenas noches, muy buen aticulo y explicación y como regalo la aplicación, solo comentar que tal es de eficaz ignorando los captchas hay alguna forma de ver los coments passed? sin ahrefs?

Saludos !

Buenas!

No hay ninguna forma de ver los comentarios passed, a no ser que sea buscando la URL en Google. Es mejor usar anti-captchas, pero en esos temas me pierdo porque no lo he probado aún. Es tarea pendiente 😀

Siento no poder ayudarte en este aspecto. Un saludo!

El link de la descarga ya no esta activo 🙁 . Saludos.

hola, no hay descarga gratis ya?

como puedo hacer para buscar por ciudades en estados unidos

como puedo hacer para buscar por ciudades en estados unidos con el programa GScraper

y si no tiene esa opcion con cual otra herramienta puedo lograrlo

saludos